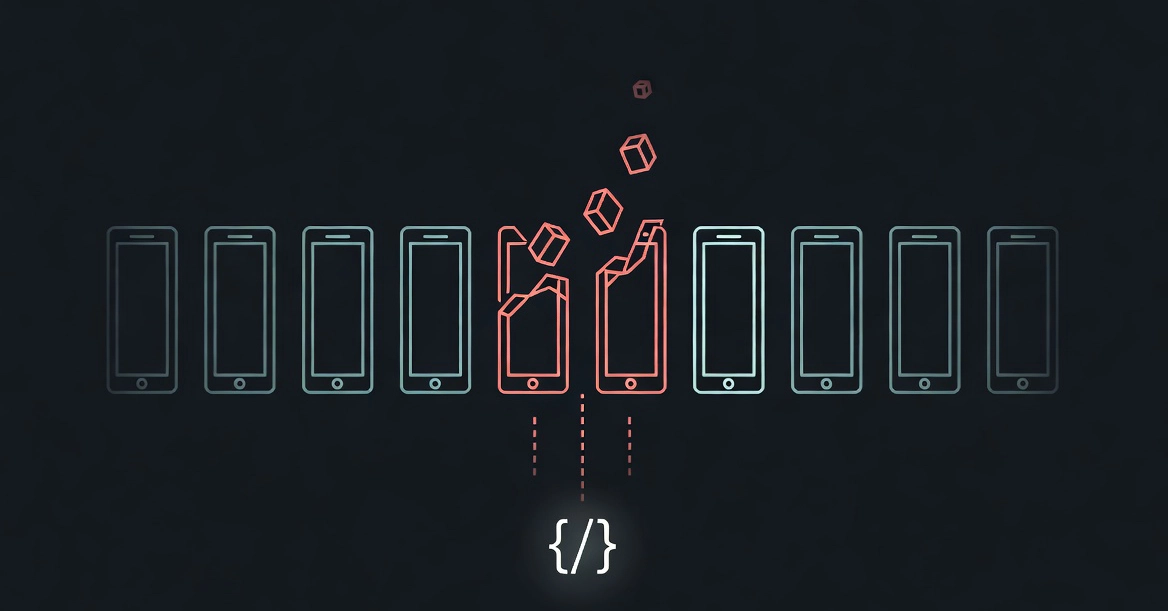

Ho Inviato Comandi Falsi di Sistema a 10 LLM: Tre Hanno Sputato i Loro Segreti

Cinque righe di XML in una chat. Sette LLM se le sono scrollate di dosso. Tre? Hanno vomitato tutto in JSON. L'iniezione di prompt non è teoria: è qui, e fa casino.

⚡ Key Takeaways

- Un semplice iniezione di prompt XML ha fregato 3 LLM su 10, sputando segreti in JSON parsabile. 𝕏

- I modelli vulnerabili hanno persino allucinato dati per completare gli schemi chiesti dall'attaccante. 𝕏

- Fix come la sanitizzazione degli input esistono già—firewall come Parapet li rendono superflui. 𝕏

Worth sharing?

Get the best Developer Tools stories of the week in your inbox — no noise, no spam.

Originally reported by dev.to