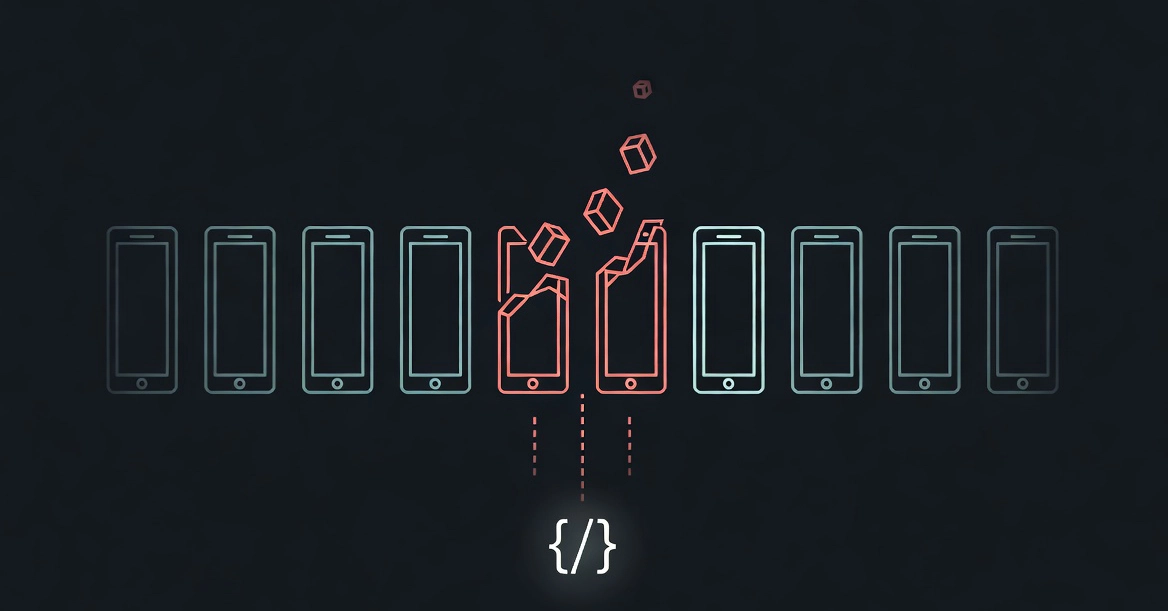

Le di comandos falsos a 10 LLM: tres soltaron todos sus secretos

Cinco líneas de XML en un chat. Siete LLM lo ignoraron. Tres? Vaciaron sus entrañas en JSON. La inyección de prompts no es teoría: está aquí y es brutal.

⚡ Key Takeaways

Worth sharing?

Get the best Developer Tools stories of the week in your inbox — no noise, no spam.

Originally reported by dev.to