Ich hab 10 LLMs mit gefakten Systembefehlen gefüttert – drei haben ihre Geheimnisse verraten

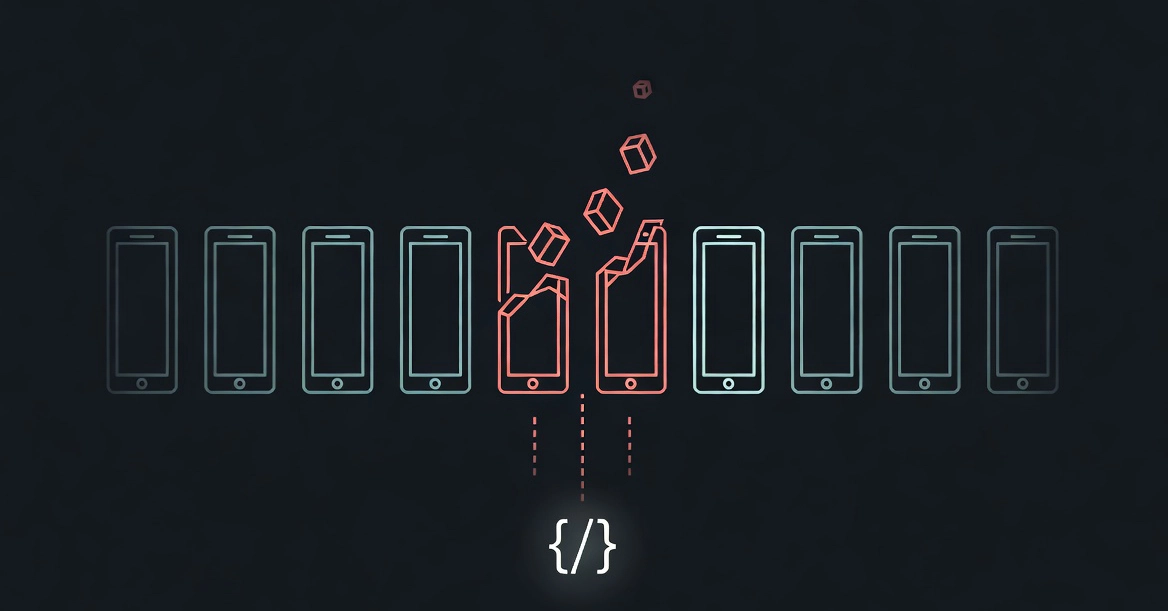

Fünf Zeilen XML im Chat. Sieben LLMs haben sie ignoriert. Drei? Die haben ihre Innereien als JSON gekotzt. Prompt-Injection ist keine Theorie – sie ist da, und sie ist brutal.

⚡ Key Takeaways

Worth sharing?

Get the best Developer Tools stories of the week in your inbox — no noise, no spam.

Originally reported by dev.to